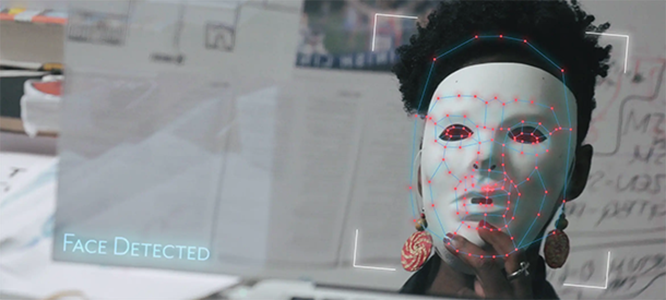

:: Coded Bias (Shalini Kantayya, 2020) [7th Empire Media / Chicken And Egg / et al.]

Certaines théories complotistes voyaient dans le code QR du passeport vaccinal le coup d’envoi du techno-totalitarisme. La boule de cristal des groupes conspirationnistes présageait un avenir où Justin Trudeau se métamorphoserait en Xi Jinping pour maintenir un contrôle coercitif sur la population. Afin d’envisager les

répercussions d’une mainmise communiste sur notre industrie cinématographique canadienne, étroitement reliée au marché américain, vous serez transporté·e·s en hypothétique « République populaire du Canada ».

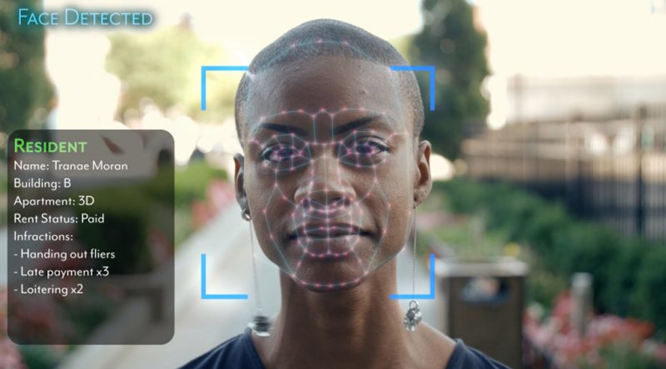

Total Trust (2023) offre un de point de départ pour imaginer ce scénario fictif. Dans ce documentaire, la réalisatrice Jialing Zhang s’attache au parcours des victimes de la surveillance totale chinoise qui mettent leur vie en péril pour une poussière démocratique balayée sous la moquette. On estime que la moitié des caméras de sécurité mondiales se trouvent en Chine, soit des centaines de millions d’appareils dont la grande majorité est équipée d’intelligence artificielle (IA) [1]. La reconnaissance faciale (RF) complète le code QR pour le contrôle d’identité, la sécurité publique et le monitorage comportemental dans les lieux publics et privés. Les modèles de dispositifs avancés de vidéosurveillance, comme Hikvision et Dahua, enregistrent des informations telles que le sexe, l’âge et l’ethnicité. Les expressions faciales et les mouvements sont analysés pour anticiper des conduites « suspectes ». L’Internet serre l’étau : « C’est l’équivalent de Google, Facebook et Amazon qui regroupent leurs données en un seul endroit et les offrent au gouvernement sans aucune protection » [2]. Le système de crédit social s’inspire de l’évaluation de la cote de crédit pour niveler la liberté individuelle. Le score, en deçà d’un certain seuil, mène à une marginalisation. Le revenu des prolétaires dépend des aléas d’un parti hégémonique qui n’a rien d’égalitaire. Ce réseau ne carbure pas qu’au big data. L’ordre politique recrute des milliers d’agent·e·s chargé·e·s d’informatiser les faits et gestes des membres des communautés afin de les rapporter aux autorités locales et participer au profilage « criminel ». Je vous invite à penser notre cinéma sur cette toile de fond qui étend radicalement le panoptisme à travers une IA androcentrée, la surhomogénéisation du contenu et l’automatisation technologique.

Dans une réalité similaire à celle de Total Trust, le gouvernement canadien contrôlerait la population par RF, tout en étant confronté à ses failles opérationnelles. Le documentaire Coded Bias (Shalini Kantayya, 2020) suit l’artiste et chercheuse du Massachusetts Institute of Technology (MIT) Joy Buolamwini, qui découvre que le système de son projet « Aspire Miroir » — une surface interactive utilisant la vision computationnelle pour modifier l’apparence de son visage — échoue à détecter sa peau foncée [3]. Elle nomme la discrimination dans les données d’entraînement des modèles d’IA qui privilégient les hommes blancs « the coded gaze ». Ce regard codé peut être comparé au « male gaze » théorisé par Laura Mulvey dans Visual Pleasure and Narrative Cinema (1975), qui critique l’objectivation des femmes par le cinéma hollywoodien [4]. Ainsi, les biais algorithmiques patriarcaux amplifient les inégalités de genre et la sexualisation des femmes. Pour Cathy O’Neil, autrice de Weapons of Math Destruction (2016), les mathématiques servent de bouclier pour les pratiques partiales des détenteur·ice·s du code. L’homme caucasien a prolongé sa vision par le prisme de ses innovations, et les femmes occupent encore un rôle minoritaire à la conception. Selon le rapport mondial sur l’écart entre les sexes de 2023, seulement 30 % d’entre elles travaillent dans le domaine de l’IA [5]. En cinéma, la parité aux postes décisionnels, qui pourrait provoquer un changement de paradigme, est loin d’être acquise. Qu’ils soient traditionnels ou émergents, les médias n’atteignent toujours pas les principes d’équité, de diversité et d’inclusion.

:: Total Trust (Jialing Zhang, 2023) [Filmtank / Witfilm / et al.]

:: Coded Bias [7th Empire Media / Chicken And Egg / et al.]

En Canada communiste, la vision artificielle accentuerait l’homogénéisation de la masse, effaçant l’individualité au profit de la cohésion. Bien que l’IA puisse « halluciner » — jargon anthropomorphique pour désigner les erreurs de perception — elle se montrerait impitoyable pour ceux et celles qui s’écartent des normes établies. Si un modèle est « suradapté » à ses données d’entraînement (ce qu’on appelle un surapprentissage), il risque de fournir des résultats « adéquats » uniquement pour des cas connus. En bref, une originalité hors norme vous indexe à la liste noire. « Big Brother » étudierait l’audience dans les salles de projection. Cette stratégie permettrait aux exploitant·e·s d’évaluer l’engagement et l’appréciation du public afin de modifier leurs campagnes publicitaires. Il pourrait donc être tentant de simuler un sentiment opposé à celui éprouvé, puisqu’un éclat de rire ou cri de terreur serait potentiellement détecté comme une anomalie s’apparentant à la contestation par le « réseau céleste » [6] et menacerait d’alerter la police. Les données biométriques des acteur·ice·s seraient numérisées sans préoccupation morale. Les interprètes entraîneraient les algorithmes, octroyant « volontairement » leurs traits faciaux et un éventail d’émotions. L’influence se ressent déjà. Pour son film Here (2024), Robert Zemeckis a opté pour un processus assisté par l’IA afin de vieillir et rajeunir Tom Hanks et Robin Wright, au détriment de la relève et de l’ancienne garde. Les doubles virtuels des vedettes décédées, éternellement rentables, ressusciteraient pour interagir avec leurs fans et défiler sur les tapis rouges d’un métavers glamourisé, où des avatars désincarnés se font photographiés près de leur étoile sur la promenade du « Hollywood Walk of Shame ». Et les figurant·e·s ? Tout bonnement éclipsé·e·s.

Dans un monde dystopique semblable à l’Empire du Milieu, nous serions instrumentalisé·e·s pour servir les objectifs politiques. Les rôles s’inverseraient ; alors que la machine s’humanise en ingérant une quantité gargantuesque de contenu créé par l’humain, l’humain se « machinise » en devenant prévisible et facilement « programmable ». Dans le documentaire AI LA (Carlo Christian Spano, 2020), un ingénieur en IA de la Silicon Valley qui automatise le travail de la main-d’œuvre s’inquiète pour l’avenir de son fils. Il entame une expédition dans la région du Caucase, espérant peut-être atteindre l’illumination spirituelle en gravissant le sommet d’une montagne. À la fin de son périple, puisqu’il n’a pas trouvé réponse à ses questions, il choisit de rencontrer une palette de spécialistes — tous des hommes — afin d’obtenir une perspective « plurielle » sur l’IA. Contrairement à Coded Bias, où des expertes telles que Meredith Broussard, Zeynep Tufekci, Amy Webb, Virginia Eubanks et Safiya Umoja Noble incitent une réflexion critique, les entretiens avec les professeurs d’IA LA (Luciano Floridi, Nick Boström et Jerry Kaplan) n’amènent aucune piste pour inspirer la prise d’action. Selon Freud, nous avons souffert de trois grandes blessures narcissiques : nous ne sommes pas au centre de l’Univers, ni supérieur·e·s au règne animal, et notre esprit échappe à notre contrôle absolu. Une quatrième vexation est maintenant envisagée ; celle où l’IA remettrait en question notre exceptionnalisme cognitif. L’automatisation intelligente n’échappe guère aux artisans du 7e art et plusieurs métiers sont menacés (graphisme, doublure, montage, effets spéciaux, etc.) pour diminuer les coûts budgétaires et accélérer l’exécution. Sous l’influence des réseaux sociaux, le visionnage des films s’adapte en formats « ultracourts ». Par exemple, The Mirror of Mountains and Seas: Breaking Waves (2024) est une série chinoise générée par IA qui a accumulé plus de 52 millions de vues [7]. Les soirées « Netflix and chill » seront révolutionnées. Showrunner, un service de streaming en développement, permettra aux utilisateur·ice·s de concevoir par IA des épisodes allant de 2 à 16 minutes. Cette plateforme éclipse la quasi-totalité de l’écosystème de la production audiovisuelle, tout en soulevant de sérieuses considérations éthiques (droits d’auteur, impacts sur l’emploi, biais, etc.) et écologiques (créer une simple image avec l’IA générative consomme autant d’énergie que charger son téléphone) [8].

:: The Mirror of Mountains and Seas: Breaking Waves (2024) [@极客电影 sur Weibo]

:: Here (Robert Zamaeckis, 2024) [Miramax / ImageMovers]

Comme dit l’adage, « on n’arrête pas le progrès ». Les mises en œuvre de l’IA en Chine illustrent une possible trajectoire future. Ne nous leurrons pas : nous offrons sans cesse des fragments de notre intimité, consciemment ou non. Nos données font rouler une industrie 4.0 caractérisée par « une série de nouvelles technologies qui fusionnent les mondes physique, numérique et biologique, impactant toutes les disciplines, économies et industries, et remettant même en question les idées sur ce que signifie être humain » [9]. Que ce soit fait de manière opaque à des fins commerciales ou en transparence pour servir le pouvoir, la sphère privée s’érode. Total Trust prouve que le passeport vaccinal n’a pas été l’élément déclencheur d’un régime communiste canadien, mais la COVID-19 a intensifié l’ultrasurveillance en Chine. En parallèle, AI LA témoigne que le point de vue masculin continue d’être privilégié à la capitale de la tech. À l’inverse, Coded Bias promeut des femmes engagées dans l’avancement des régulations autour de l’IA. Le contexte socio-politique est le miroir de la culture, restons vigilant·e·s afin de trouver notre équilibre.

[1] « Nombre de caméras de surveillance pour 1 000 habitants par ville dans le monde en 2023 », Statista (21 février 2024),

https://fr.statista.com/statistiques/1374821/nombre-camera-surveillance-par-habitant-ville-monde/#:~:text=La%20Chine%20domine%20la%20surveillance,sont%20dans%20des%20villes%20chinoises.

[2] Shannon Tiezzi, « Josh Chin and Liza Lin on China’s Domestic Surveillance », The Diplomat (1er mars 2023),

https://thediplomat.com/2023/03/josh-chin-and-liza-lin-on-chinas-domestic-surveillance/.

[3] Jusqu’à récemment, Kodak utilisait le terme « China Girls » — une appellation ambigüe dont l’origine est débattue — pour désigner les images des jeunes femmes dont la peau rappelant la teinte de la porcelaine permettait de calibrer et standardiser la balance des couleurs de leurs pellicules.

[4] Les superproductions hollywoodiennes dépendent du marché chinois pour rentabiliser leurs productions, qui sont aujourd’hui planifiées en fonction des censeurs.

[5] « Global Gender Gap Report 2023 », World Economic Forum (20 juin 2023),

https://www.weforum.org/publications/global-gender-gap-report-2023/.

[6] « Eyes in the sky » désigne les caméras de surveillance pilotées en temps réel par l’IA, opérant depuis une perspective dominante par les services d’État.

[7] Li Xin et Lin Liuhan, « With AI, China’s New Hit Dramas Are Virtually Writing Themselves », Sixthtone (14 août 2024), https://www.sixthtone.com/news/1015691.

[8] « Créer une image avec l’IA générative consomme autant d’énergie que charger son téléphone », Ministère de l’Économie, de l’innovation et de l’Énergie du Québec (22 janvier 2024),

https://www.economie.gouv.qc.ca/objectifs/informer/vecteurs/vecteurs-economie-et-innovation-detail/creer-une-image-avec-lia-generative-consomme-autant-denergie-que-charger-son-telephone.

[9] The Fourth Industrial Revolution, by Klaus Schwab, World Economic Forum (2024),

https://www.weforum.org/about/the-fourth-industrial-revolution-by-klaus-schwab/.

|

envoyer par courriel |

| imprimer | Tweet |